Visión y robótica:felices juntos

Es posible que el próximo "dúo dinámico" no involucre a humanos en absoluto. “La visión artificial y los robots forman una unión perfecta”, afirmó Klas Bengtsson, gerente global de productos, sistemas de visión de ABB Robotics (Auburn Hills, MI). Esto no es nuevo. La visión y la robótica han ido de la mano durante años. Pero a diferencia de otros matrimonios, este está prosperando a medida que la visión artificial se expande en capacidad y encuentra nuevas aplicaciones. El matrimonio “perfecto” del pasado consistía en guiar al robot. Pero las nuevas aplicaciones, como los hijos de un buen matrimonio, ahora incluyen la inspección de piezas, la lectura de códigos de barras o QR para la trazabilidad y la búsqueda de nuevas formas de empacar y desempacar las piezas.

Todo se reduce a la flexibilidad que proporciona la visión artificial . “Vision ha ayudado a ABB a mejorar las capacidades de muchas aplicaciones robóticas”, dijo.

La necesidad de robots de guía flexibles ha sido impulsada por la creciente diversidad de productos y la necesidad de acortar los plazos de entrega en muchas industrias. ¿Por qué es tan importante la flexibilidad? “Si codifica la automatización robótica, en el momento en que cambia un producto o algo en su línea de producción, debe cambiar el programa”, dijo Bengtsson. Esto también significa cambiar la fijación de precisión o la forma de colocar una pieza para que un programa de guía de robot codificado pueda recoger, pulir o operar de otra manera en la pieza de manera confiable. Los costos se suman.

La visión artificial ayuda a contener esos costos al permitir que el robot "vea" las variaciones en las piezas y la orientación. Los sensores de escaneo 3-D están abriendo aún más aplicaciones nuevas. Dijo Bengtsson:"La pregunta hace 15 años era '¿Por qué usar la visión artificial?'. La pregunta actual es:'¿por qué no?'".

Los humanos y los robots colaboran

Rethink Robotics (Boston), fundada en 2008, construye robots colaborativos o cobots. Su producto estrella es Sawyer. “Un cobot como nuestro robot Sawyer se utiliza mejor para realizar tareas repetitivas y mundanas a escala humana”, dijo Mike Fair, gerente de producto. Esto significa trabajar con productos o movimientos que replican lo que hace un ser humano que también es abrumadoramente repetitivo y mundano.

“Las aplicaciones como esta incluyen embalaje, mantenimiento de máquinas, carga y descarga de líneas, inspección y pruebas de placas de circuitos impresos”, dijo. El manejo de materiales para máquinas CNC es otra aplicación, reemplazando a un humano que carga una máquina CNC, la cicla, espera a que finalice la tarea de mecanizado y luego descarga la máquina.

Rethink cree tanto en la visión artificial que incorpora una cámara en la muñeca de cada Sawyer. “El sistema de visión incorporado [hace] que nuestro cobot sea más rápido y fácil de implementar, eliminando las molestias y el costoso tiempo de integración de los sistemas típicos de visión artificial. Agregamos software para facilitar la implementación de [esos] sistemas de visión”, dijo Fair. En la feria comercial ATX West 2018, realizó una demostración que demostró que incluso un periodista puede programar una tarea simple en unos pocos minutos. Junto con pegatinas codificadas que parecen códigos QR, su software ayuda al robot a posicionarse para adaptarse a la variabilidad en la celda de trabajo. Esto también facilita el movimiento de los robots Sawyer de una tarea a otra y de un lugar a otro.

Universal Robots USA Inc. (UR; Ann Arbor, MI) también se dedica a los robots colaborativos. Sus tres robots, que varían en carga útil de 3 a 10 kg, operan dentro de un "ecosistema" de proveedores externos. Ofrece un programa de desarrollo gratuito llamado Universal Robots+ para permitir que los proveedores externos de efectores finales, sistemas de visión y otros periféricos desarrollen complementos que se conectan y funcionan con sus cobots.

El sitio web de la empresa muestra seis opciones diferentes de visión dentro este ecosistema que es adecuado para recoger y colocar, automatización de máquinas CNC, empaque y paletización, ensamblaje, atornillado y mantenimiento de máquinas. Ambos escáneres 2D y 3D están disponibles. Hay disponibles varios paquetes de software de simulación y control de movimiento de robots.

Integración, Facilidad de uso

Para que la visión artificial sea útil, debe ser accesible, un elemento importante del ecosistema de UR. Por ejemplo, uno de sus paquetes de terceros se llama Universal Metrology Automation, ofrecido por 3D Infotech. Ofrece integración de sistemas de control de movimiento, escáneres 3D y software de inspección para crear una solución de metrología automatizada y configurable. Otros programas brindan programación en línea o fuera de línea, software de simulación robótica y capacidades de monitoreo.

“Hoy existe una integración mucho mejor con los robots y los sistemas de visión”, dijo Rob Antonides, presidente de Apex Motion Control (Surrey, BC). Apex es un integrador que ha aprovechado al máximo el enfoque de ecosistema de UR. “Solíamos tener que combinar sistemas de visión con controladores de robot, pero hoy en día son más fáciles de conectar y usar, a través de Ethernet IP o cualquier tipo de red. Hace veinte años, me tomaba una semana configurar un sistema robótico guiado por visión y las comunicaciones; hoy son de 15 a 20 minutos”.

La visión artificial ha demostrado ser especialmente útil para Apex. Las tareas que ha automatizado incluyen una variedad de operaciones de horneado, incluida la decoración de pasteles. “Los sistemas de visión le permiten lidiar con las inconsistencias y la presentación y el posicionamiento del producto menos que perfectos. Mapeamos la superficie de un pastel con un sensor 3D para poder decorarlo rápida y fácilmente”, dijo Antonides.

FANUC también enfatiza la fácil integración. “Lanzamos un controlador completamente nuevo a fines del año pasado, que presenta funciones destacadas para la visión robótica integrada”, explicó David Dechow, ingeniero de personal de robótica inteligente/visión artificial de FANUC America Corp. (Rochester Hills, MI). “En FANUC, todos nuestros sistemas de visión ahora están integrados en el controlador”. FANUC fue una de las primeras empresas de robots en incluir la visión para guiar la robótica y la ofreció hace 30 años como una opción en sus sistemas de guía robótica.

Dechow también observó que las empresas de visión artificial se han concentrado en desarrollar interfaces más sencillas con los robots. “Los proveedores de visión están apoyando notablemente este mercado”, afirmó. “El trabajo pesado para hacer que la colaboración funcione está en el lado de la visión. El robot está esperando un punto. El truco está en usar la visión artificial para encontrar el punto correcto, fusionando el sistema de coordenadas del sistema de visión artificial con el sistema de coordenadas del robot”. Estuvo de acuerdo con otros entrevistados para este artículo en que la visión artificial proporciona una flexibilidad incomparable en muchas tareas de automatización. Hoy, la relación costo/beneficio está comenzando a favorecer la visión sobre la fijación de precisión y la codificación, dijo.

IA:poses y discriminación

Una discusión sobre visión, datos y robots lleva naturalmente a la pregunta de cuán útil sería la inteligencia artificial (IA) para los robots videntes. Dechow notó una trampa:la IA no es particularmente aplicable a la guía robótica. “El aprendizaje de IA es excepcionalmente bueno en la categorización y diferenciación. En lo que no es bueno es en el análisis discreto”, explicó. Un robot necesita moverse a un punto discreto. Cuando se combina con sistemas de metrología, mide cantidades geométricas discretas. “No hay nada que aprender”, dijo.

Pero no termina ahí. Si no es aplicable a la orientación, hay tareas robóticas en las que la IA ofrece valor. “Por ejemplo, identificar y clasificar un objeto contra su fondo para determinar el objeto sobre el que operará el robot, combinado con la guía robótica, sería una buena aplicación híbrida”, dijo. Otro está en la optimización de selección y agarre. “Encontrar la orientación ideal del brazo en el espacio y la ruta de aproximación cae en un dominio de aprendizaje en lugar de [ser] determinista. Hay muchas orientaciones que son tanto buenas como malas”, explicó. "La IA es especialmente útil cuando las piezas son aleatorias y no homogéneas en cuanto a ubicación y tamaño".

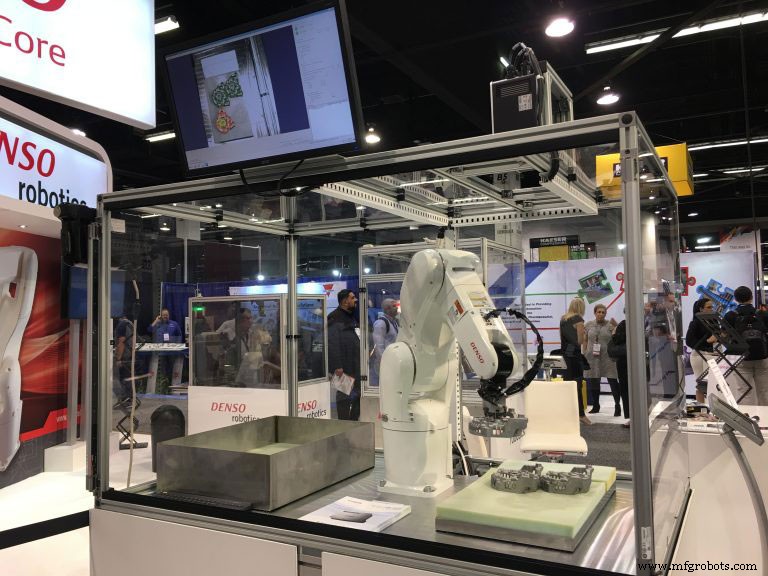

Peter Cavallo de Denso Products and Services Americas Inc. (Long Beach, CA) estuvo de acuerdo en que el aumento sustancial en la capacidad del sistema de visión es real y ha abierto nuevas oportunidades para aplicaciones robóticas. “En su forma más simple, [la visión] encuentra una parte u objeto y opera sobre él. En su forma más compleja, que estamos viendo ahora, puede ver cosas, interpretar, reconocer y ver la pieza por lo que es, incluso en diferentes configuraciones o posiciones, sin mover la pieza o el robot”.

Él ve el escaneo 3D como un desarrollo especialmente importante, haciendo que las tareas que antes eran difíciles, como la recolección de basura, sean sencillas. El último sistema de Denso utiliza un sistema de visión de luz estructurada para ver en 3D con un detector CMOS.

Su visión de aplicar IA a la robótica se basa en un contexto de sistema más amplio. “A medida que avanzamos hacia la próxima generación de robots, comenzamos a entrar en cosas como el aprendizaje profundo, donde la visión se convierte en parte de un sistema completo”, explicó. “Mostramos algo en la feria de robots de Tokio que mostraba aprendizaje profundo en un sistema con 28 grados de libertad que incluía dos robots con manos que preparaban una ensalada”. ¿Por qué deberían impresionarse los usuarios industriales? El robot seleccionó lechugas, frutas y verduras utilizando solo el conocimiento proporcionado de antemano. “Nosotros no programamos el robot; en cambio, le dijimos lo que queríamos”, dijo. Piense en la cantidad de tareas no estructuradas que existen en el taller que serían ideales para dicha automatización.

No solo para los grandes

La visión artificial, la integración, el software e incluso la IA pueden hacer pensar que este nivel de automatización robótica es solo para las empresas Fortune 500. Ese no es el caso. “Es muy aplicable a las pequeñas y medianas empresas porque la visión hoy en día tiene un costo razonable. Lo que solía costar entre $50 000 y $100 000 ahora es menos de $5000. No hay razón para ser tímido”, dijo Cavallo.

Rick Brookshire, gerente de producto de Epson America Inc. (Carson, CA), estuvo de acuerdo en que la automatización robótica es ideal para las pequeñas y medianas empresas (PYME). “Además de los clientes más grandes que compran 50, 100 o incluso 1000 robots, tenemos muchos clientes más pequeños que compran uno, dos o tres robots”, dijo. Epson se especializa en robots más pequeños optimizados para tareas de alta precisión, haciendo crecer su negocio de robots a partir de sus propias necesidades en la construcción de relojes de alta precisión. “Todos nuestros robots están disponibles con guía de visión integrada, una función que ha ido ganando aceptación. También se está volviendo más confiable. La gente está más dispuesta a usarlo”, dijo.

Al igual que otros entrevistados para esta historia, él cree en la simplicidad es vital, especialmente para satisfacer las necesidades de las PYMES. El programa Epson Vision Guide utiliza una interfaz GUI de apuntar y hacer clic basada en objetos, lo que permite a los desarrolladores desarrollar aplicaciones rápidamente, según la compañía. Si bien la aplicación robótica guiada por visión ideal es algo en lo que las piezas no se colocan bien dentro de un nivel de tolerancia razonable, o no se pueden presentar de manera consistente, la precisión que brindan los robots Epson abre otro campo de uso.

Las tolerancias son cada vez más estrictas. Las piezas son cada vez más pequeñas. La colocación de precisión es cada vez más difícil. “Ahí es donde los robots de precisión como los de Epson pueden ayudar”, dijo. “Esto está sucediendo cada vez más en las empresas más pequeñas. Y estos robots se están volviendo tan fáciles de usar que muchos de nuestros clientes hacen la integración por su cuenta”. Los robots incluso colocan tornillos de menos de 0,7 mm de diámetro. A medida que la fuerza laboral envejece, esto puede convertirse en un factor crítico.

James Cooper, vicepresidente de ventas de Applied Manufacturing Technologies (AMT; Orion, MI), tiene una perspectiva única basada en su experiencia en la industria de fabricación automotriz. AMT es un integrador de sistemas que se especializa en sistemas de robots guiados por visión. Los números de pieza múltiples con sistemas complejos, como en los casos de transmisión, son cada vez más frecuentes. Una caja de transmisión es un objeto grande con muchos orificios y superficies complejas, ideal para la visión pero costosa para la fijación dura de precisión. “Los tamaños de los lotes también son cada vez más pequeños con cambios más frecuentes. Es por eso que los sistemas de visión guiada por robot se están volviendo tan críticos en muchas aplicaciones”. También observó el crecimiento de los sistemas de visión 3D, especialmente en aplicaciones de recolección de contenedores y bolsas.

Va más allá de la orientación. “La inspección de calidad es una aplicación ideal, ya que busca la presencia y ausencia de orificios y otras características o determina si un componente se ensambló correctamente”, dijo. Otra área rica es la inspección metrológica. “Construimos un sistema con nuestro socio Hexagon que se basa en un robot colaborativo que inspecciona el producto de un cliente. Esto solía hacerse en una CMM en una sala separada con temperatura controlada. Durante muchos años, los fabricantes querían hacerlo en la planta de producción. Ahora es posible tener un sistema completamente portátil, sin protección, ideal para aplicaciones de inspección de primeros artículos, directamente en la máquina de producción”, dijo.

Estuvo de acuerdo en que estas aplicaciones están creciendo en las PYMES. También señaló que estas operaciones tienen dificultades para encontrar mano de obra calificada, lo que genera la necesidad de una mayor automatización.

ABB también ha desarrollado un sistema de inspección robótica a través de una colaboración con NUB3D (que posteriormente adquirió), un innovador líder en soluciones de control de calidad e inspección digital 3D. El sistema llave en mano consiste en un sensor de escaneo de luz blanca 3D montado en el brazo de un robot ABB.

Stäubli Corp. (Duncan, SC) is a robot company that uses a variety of machine vision from third-party vendors to build applications for robot vision guidance. But it also offers another use of vision systems with industrial robots that need human interaction:a virtual safety fence around robots.

As explained by Olivier Cremoux, business development manager, North America robotics for Stäubli, man/robot collaboration can be binned into five different stages. The lowest stage 1, common in most industrial robots, is no direct contact, where any interaction between man and machine is dangerous. “The robot and operator are separated by hard fences,” he said. The highest, stage 5, is where contact is desired and required, for example when a robot is hand guided by an operator to carry out or assemble a heavy tool or other simultaneous motions with a robot. There are stages in-between where some contact is desired at different levels, and where the robot often needs to stop and let the human do something. “This in-between represents 95% of collaborative applications,” he said.

In these intermediate stages, a 3D scanning vision system that scans outwards from the workcell can detect a human approaching. Within a certain distance, it signals the workcell to slow the robot down to prevent contact and possible injury. As the human approaches even closer, it stops the cell entirely. This allows the human to perform an action, such as inspection or placement, then move away, allowing the cell to automatically restart.

HNJ Solutions Inc. (Carson, CA) is an integration company founded to provide vision systems for manufacturing, including with robots, according to President Greg McEntyre. While acknowledging that vision systems are indeed becoming easier to use and install, he says there remains a class of applications where integrators like HNJ are needed. “In complex applications with multiple colors, sizes, orientations, and general uncertainty, it is important to know how cameras work and why they work to install a good system,” he said.

He emphasized how 3D cameras are expanding relevant applications, such as bin picking. “Today we are even importing the CAD model of our objects so that the vision system can understand in 3D the object it needs to pick or operate on,” he said. “Cameras give complete freedom.”

What advice might he offer, as an integrator of complex vision and robotics? “While it may not be easy as it looks, I would say just jump in,” he said. “There is so much useful hardware that vision guidance and vision applications are becoming ever more useful.” In other words, just do it.

Sistema de control de automatización

- Ventajas y desventajas de una máquina de torno

- Fanuc abre nuevas instalaciones de robótica y automatización

- ABB y B&R lanzan la 'primera solución de robótica centrada en la máquina totalmente integrada'

- SICK presentará un seminario web sobre la personalización de la visión artificial

- Elementary Robotics recauda $ 13 millones para sus ofertas de aprendizaje automático y visión por computadora para la industria

- El papel de la robótica y la automatización en la Industria 4.0

- Seguridad de accionamientos y máquinas

- Dispositivos de seguridad y consideraciones

- ABB Robotics:Innovación tecnológica e I+D en robótica

- Mejor juntos:maquinistas y programadores

- Máquina de sierra de cinta y productividad