¿Es 2017 el año de la interfaz de voz?

En los últimos años, los avances significativos en el reconocimiento automático de voz (ASR) han dado lugar a una gran cantidad de dispositivos y aplicaciones que utilizan la voz como interfaz principal. El IEEE Spectrum revista ha declarado 2017 el año del reconocimiento de voz; ZDNet informó de CES 2017 que la voz es la próxima interfaz de computadora; y muchos otros comparten puntos de vista similares. Entonces, ¿dónde estamos con respecto al avance de las interfaces de voz? Esta publicación analizará el estado actual de las interfaces de voz y sus tecnologías habilitadoras.

¿Cuántos de tus dispositivos conversan contigo?

La activación por voz nos rodea. Casi todos los teléfonos inteligentes tienen una interfaz de voz, con productos emblemáticos como el Apple iPhone 7 y el Samsung Galaxy S7 que incluyen funciones de escucha permanente. La mayoría de los relojes inteligentes ofrecen activación por voz, así como otros dispositivos portátiles, y especialmente dispositivos audibles, como los AirPods de Apple y el Gear IconX de Samsung. En la mayoría de esos dispositivos, no existe una forma conveniente de integrar ninguna otra interfaz, lo que hace que la voz sea una solución ideal y necesaria. Las cámaras nuevas, como la GoPro Hero 5, se pueden operar mediante comandos de voz, lo cual es ideal para selfies. Los sistemas de información y entretenimiento para automóviles activados por voz se han convertido en una mercancía, lo que hace que sea mucho más seguro cambiar de estación mientras se conduce.

El Amazon Echo encendió la tendencia del asistente de conversación, que está en llamas con Google Home tratando de competir y una variedad de clones similares exhibidos en CES 2017. El servicio de voz de Echo, llamado Alexa, viene con varias habilidades integradas. Por ejemplo, puedes decir "Alexa, cuéntame un chiste" (entrega muy irónica), "Alexa, ¿ganaron los Warriors?" (por supuesto que sí), o "Alexa, ¿quién protagonizó la película 2001:A Space Odyssey?" (nadie más parece saberlo). También hay un montón de huevos de Pascua divertidos, como la respuesta cuando dices "Alexa, inicia la secuencia de autodestrucción". (vea también este video que muestra algunos de los huevos de Pascua de Alexa).

Además de las funciones integradas, terceros pueden agregar nuevas capacidades a Alexa mediante el Alexa Skills Kit (ASK). Este ASK permite a los desarrolladores enseñar a Alexa nuevas habilidades para que ella (¿o él?) Pueda controlar e interactuar con más productos y servicios. Como puede ver en este video, por ejemplo, una persona pirateó su iRobot Roomba y agregó una habilidad para controlar el robot aspirador.

Otras habilidades de Alexa incluyen cosas útiles, como pedir comida en una variedad de restaurantes o llamar a un Uber, y entretenimientos aleatorios, como hacer preguntas mágicas con bolas de 8, trivialidades de Seinfeld y aprender nuevos datos sobre frutas. Las colaboraciones entre Amazon y empresas como Whirlpool y GE también fortalecerán la aptitud de Alexa en el hogar inteligente, al agregar capacidades para controlar electrodomésticos como lavadoras, refrigeradores, lámparas y más.

Actualmente, Amazon parece estar a la cabeza en este mercado, pero otros están haciendo grandes esfuerzos (e inversiones) para ponerse al día. Mark Zuckerberg reclutó a Morgan Freeman para que fuera la voz de su asistente de voz de inteligencia artificial (IA). Según una nota que describe cómo la construyó, Zuckerberg pasó un año desarrollando la aplicación como una simple IA para ayudar a administrar su hogar "como Jarvis en Iron Man" (también lo llamó Jarvis). Jarvis supuestamente identifica quién está hablando por su voz y también reconoce rostros, por lo que puede dejar entrar a personas autorizadas en la puerta mientras informa a Zuckerberg.

Otro contendiente interesante es un dispositivo japonés tipo Amazon Echo llamado Gatebox, que presenta un personaje holográfico llamado Azuma Hikari.

Respuesta de Japón al Amazon Echo (Fuente:Gatebox)

Además de un altavoz simple, el dispositivo utiliza una pantalla y un proyector para darle vida al asistente virtual tanto de forma visual como auditiva. Además de micrófonos, también cuenta con cámaras y sensores de movimiento y temperatura que le permiten interactuar con el usuario de una manera más holística.

¿Cómo funciona esa captación de voz de campo lejano?

¿Cómo escucha y comprende un dispositivo sus comandos de voz mientras reproduce música en el otro lado de la habitación? Hay muchos componentes involucrados para permitir esta hazaña, pero algunos de ellos son primordiales. Primero está el motor de reconocimiento automático de voz (ASR), que permite a las máquinas convertir los sonidos que hacemos en instrucciones ejecutables. Para que el motor ASR funcione correctamente, necesita recibir una muestra de voz limpia. Esto requiere reducción de ruido y cancelación de eco para filtrar las interferencias. Las siguientes son algunas de las tecnologías más importantes que permiten la captación de voz de campo lejano:

Aprendizaje profundo tiene un papel muy importante en esto. La capacidad de comprender el lenguaje natural se estableció hace bastantes años, pero los refinamientos recientes la han acercado a la capacidad del nivel humano. Utilizando técnicas basadas en el aprendizaje como las redes neuronales profundas (DNN), tanto el procesamiento del lenguaje como el reconocimiento de objetos visuales han igualado o superado el rendimiento humano en muchos casos de prueba. Los DNN se generan utilizando conjuntos de datos masivos durante la fase de entrenamiento. Una vez realizado el entrenamiento sin conexión, los DNN se utilizan para realizar su función en tiempo real.

Formación de haz adaptable es clave para una interfaz de usuario robusta activada por voz. Permite funciones como la reducción de ruido, el seguimiento de los altavoces en caso de que el usuario se mueva mientras habla y la separación de los altavoces para cuando varios usuarios hablan simultáneamente.

Beamforming usando una matriz de micrófonos hexagonales (Fuente:CEVA)

Este método utiliza varios micrófonos en posiciones fijas entre sí. Por ejemplo, The Amazon Echo usa siete micrófonos en un diseño hexagonal con un micrófono en cada vértice y otro en el centro. El tiempo de demora entre la recepción de la señal en los distintos micrófonos permite que el dispositivo identifique de dónde proviene la voz y cancele los sonidos provenientes de otras direcciones.

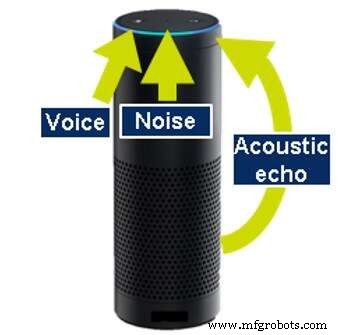

Cancelación de eco acústico es necesario porque muchos de los productos que realizan el reconocimiento automático de voz también producen sonidos por sí mismos; por ejemplo, reproducir música o entregar información. Incluso mientras se realizan estas acciones, los dispositivos deben poder escuchar para que el usuario pueda interrumpir (irrumpir) y detener la música o solicitar una acción diferente. Para seguir escuchando, la máquina debe poder cancelar el sonido que genera. Esto se llama cancelación de eco acústico (AEC).

Cancelación de eco acústico (Fuente:CEVA)

Para realizar AEC, el dispositivo debe ser consciente del sonido que está haciendo, ya sea analizando los datos de salida o escuchando los sonidos generados con un micrófono dedicado adicional. También se aplica una tecnología similar para eliminar los ecos que rebotan en las paredes y otros objetos alrededor del dispositivo.

Una plataforma de desarrollo de múltiples micrófonos para modelar DNN, formación de haces y algoritmos de cancelación de eco (Fuente:CEVA)

Otro tipo de eco lo generan los propios comandos del usuario cuando rebotan en los objetos o en las paredes. La cancelación de ecos tan impredecibles requiere otro algoritmo más llamado desverberación. Luego, el sonido se filtra y la máquina puede escuchar los comandos del usuario.

Las interfaces de voz actuales están lejos de ser perfectas

Por un lado, 2017 parece ser un año digno de mención para las interfaces de voz considerando lo generalizadas que ya se han vuelto. Por otro lado, incluso con todos los impresionantes avances de los últimos años, todavía queda un largo camino por recorrer.

Siguen existiendo muchos problemas con las implementaciones actuales de interfaces de voz en dispositivos producidos en masa, pero ese será el tema de una columna futura. En mi próxima publicación, planeo ver algunas de las fallas y características faltantes que afectan a las interfaces de voz de hoy. Asegúrese de sintonizarnos.

Eran Belaish es Gerente de Mercadeo de Productos de la línea de productos de audio y voz de CEVA, y prepara soluciones exquisitas que van desde activación por voz y voz móvil hasta audio inalámbrico y audio doméstico de alta definición. Aunque no está ocupado con el fascinante mundo del sonido envolvente, a Eran le gusta sumergirse en el fascinante silencio del mundo submarino.

Incrustado

- El CEO de Monroe Engineering es finalista en Emprendedor del año por EY

- La interfaz de línea de comandos

- MajorTom:ARDrone 2.0 controlado por voz de Alexa

- Proveedor nombrado por Motion del año

- Mobius gana premios al Producto del año

- 2020 será el año de la inteligencia continua

- Tendencias de CMMS 2019:El año del cliente

- ¡Monroe ganó negocio del año 2019!

- La gran competencia de cocina con chili de Wisconsin

- La voz unida de la industria del aire comprimido

- Un año en revisión:2017