Habilitando el hardware para el metaverso

Se habla mucho del metaverso, especialmente con empresas como Facebook y Nvidia que presentan sus visiones del futuro digital. Pero, ¿qué es exactamente el metaverso, cuáles son los desafíos de hardware para habilitarlo y qué elementos ya están en su lugar? La firma de analistas IDTechEx exploró el progreso en áreas como pantallas, sensores de imagen, óptica, háptica, realidad aumentada / realidad virtual con cierta profundidad recientemente; presentamos algo de esa discusión aquí.

El juego final para el metaverso es que los mundos virtuales existan a la perfección junto con los reales, con interacciones inmersivas entre los dos que cambian nuestra percepción de la presencia física. El software para esto está casi listo, pero el hardware todavía tiene muchos obstáculos que superar.

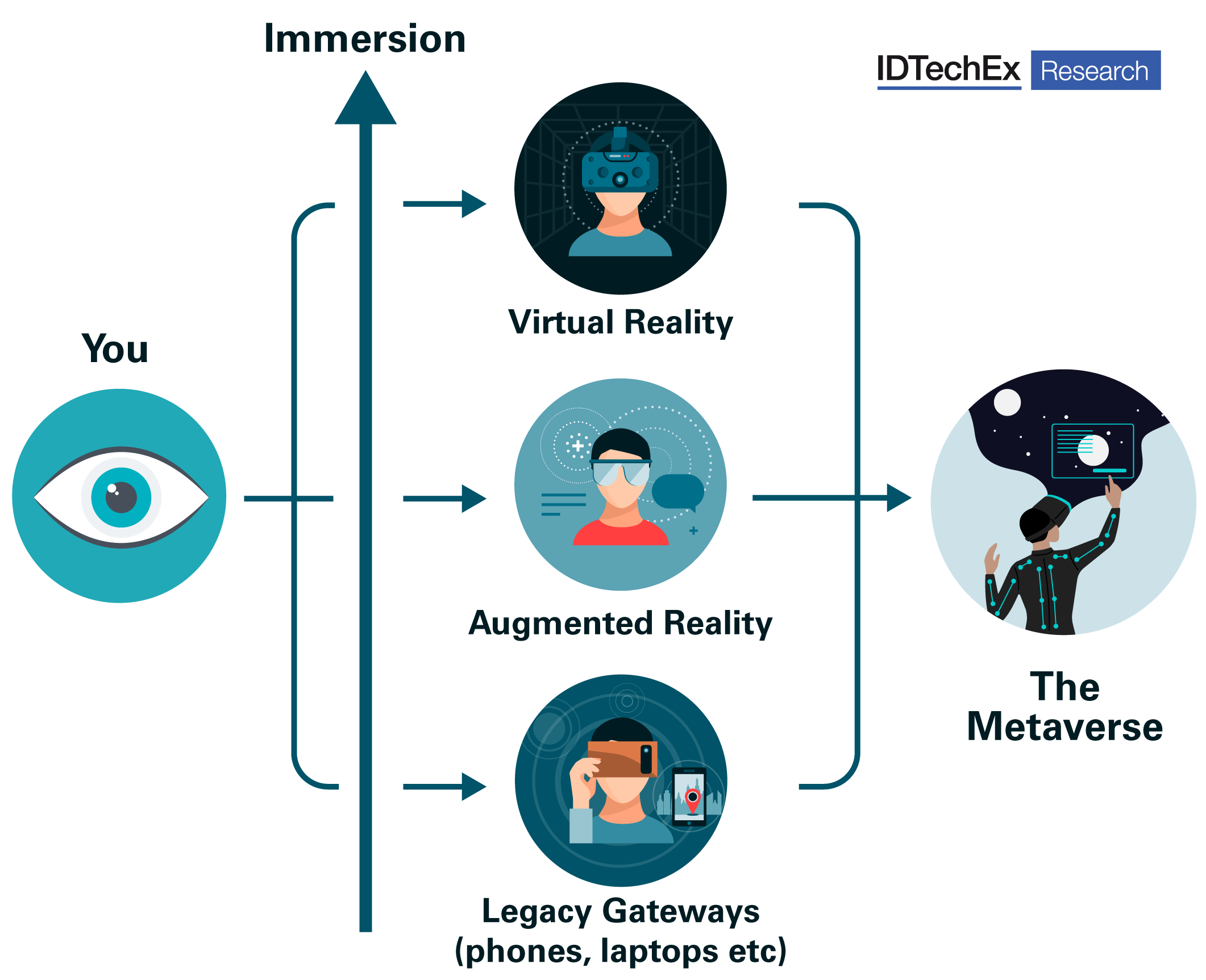

El metaverso promete un cambio radical en la forma en que la sociedad se comunica pero, sin la tecnología de hardware, en última instancia seguirá siendo una quimera. Aún podremos interactuar con el metaverso a través de nuestros teléfonos y computadoras portátiles, pero estos se convertirán en dispositivos heredados. Para sumergirnos, esto requiere un casco de realidad virtual (VR); para una verdadera integración entre lo creado y lo físico, se requieren dispositivos de realidad aumentada (AR).

Una piedra de toque en las industrias de dispositivos AR / VR es la aceptabilidad social y sin los avances en la tecnología de detección, visualización y óptica, los auriculares AR y VR no serán lo suficientemente elegantes para lograrlo. A pesar de que se invirtieron miles de millones de dólares en el desarrollo, IDTechEx dijo que las verdaderas gafas AR todavía no están ni cerca del punto de estar junto a las Ray-Ban en términos de apariencia o mostrar imágenes de calidad IMAX. Meta (antes Facebook) anunció su proyecto de gafas AR al mismo tiempo que cambiaba de nombre, admitiendo que estaban a años de ser viables. Los cascos de realidad virtual a veces invitan a comparaciones con Robocop:solo los dispositivos de gama más alta comienzan a difuminar las líneas entre lo que es real y lo que no lo es.

A largo plazo, el objetivo es un dispositivo liviano y cómodo que pueda usar todo el día, cambiando entre AR y VR mientras permite interacciones naturales entre usted y otros usuarios de metaverso. El viaje tecnológico hacia el hardware necesario para crear este dispositivo hipotético presenta desarrollos aún más convincentes y desafíos complejos que el software.

Las pantallas MicroLED son parte de la solución

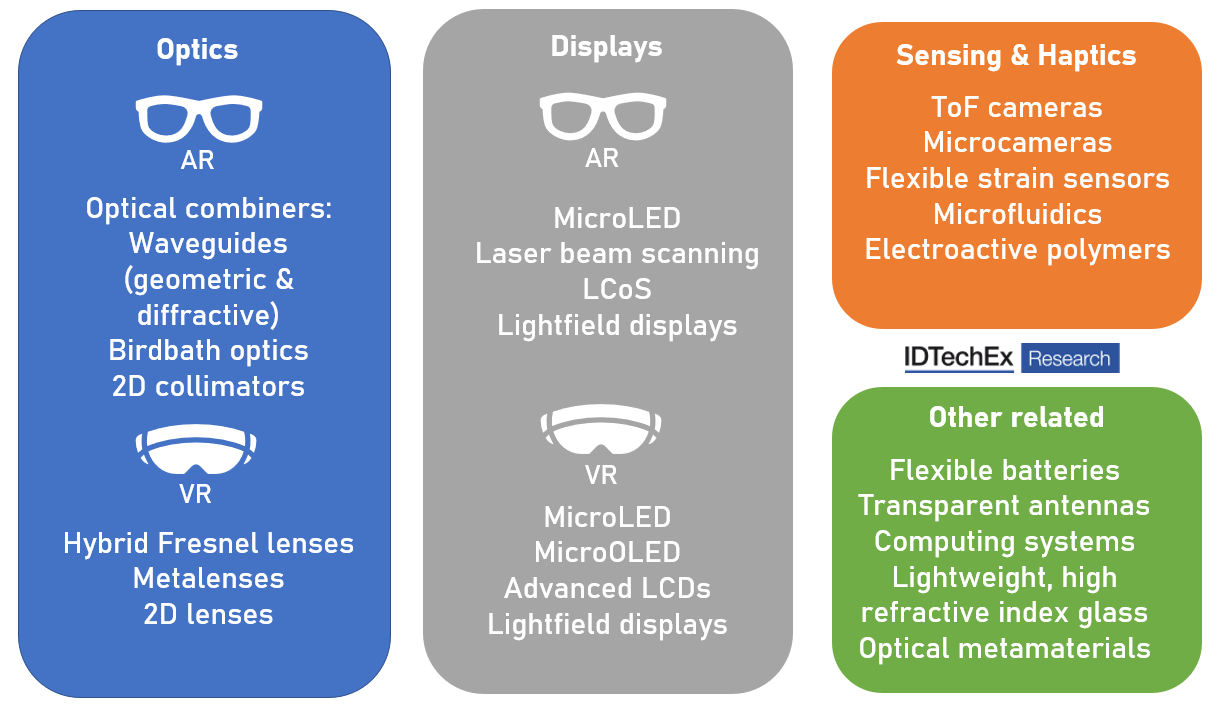

Poner una pantalla justo frente a tus ojos revela cosas que no notamos mientras miramos un teléfono o TV. Vemos los espacios entre píxeles en un fenómeno llamado efecto de puerta de pantalla y la regla general es que se requieren 60 píxeles por grado (ppd) de campo de visión para que la realidad virtual o la realidad aumentada comiencen a parecerse a la realidad, lo que genera grandes demandas de resolución. . Además de esto, se requieren ópticas para enfocar y dimensionar estas imágenes correctamente para nuestra visión. En el caso de AR, estas ópticas son muy ineficientes, lo que genera demandas de brillo de millones de nits; como referencia, la pantalla del iPhone 13 Pro Max alcanza un máximo de 1200 nits.

Las pantallas MicroLED son una solución prometedora para AR y VR. No sufren quemaduras como las pantallas OLED, pueden tener niveles de brillo locos (JadeBird hace uno para aplicaciones de realidad aumentada con un nivel de brillo máximo de 3 millones de nits) y permiten pequeños pasos de píxeles, con Mojo Vision produciendo lo que ellos llaman un nanoLED. pantalla que es lo suficientemente pequeña como para caber en una lente de contacto y tiene un paso de subpíxeles de 900 nm.

Sin embargo, hay un problema importante:las micropantallas microOLED no son buenas para producir imágenes a todo color, y los microLED azules son significativamente más eficientes que otros colores. La conversión de color de puntos cuánticos es la solución preferida aquí, ya que permite la conversión de la luz azul en rojo y verde, y estos puntos cuánticos se pueden imprimir con inyección de tinta o modelar litográficamente. Todavía existe preocupación por la longevidad, especialmente en micropantallas muy brillantes, así como por la dependencia de los metales pesados en muchas formulaciones. El cronograma de desarrollo de las pantallas microLED se describe en detalle en este informe sobre tecnología, comercialización, oportunidad, mercado y jugadores.

El campo de batalla más grande para AR, en particular, es la óptica combinada. Estos dispositivos superponen imágenes proyectadas en una lente transparente. Aquí, las empresas luchan por la mejor reproducción del color, el campo de visión más amplio y la caja de ojos más grande para permitir una experiencia de visualización convincente que funcione para cada par de ojos.

Teniendo en cuenta las grandes novedades de este año en esta área, las guías de ondas de relieve superficial parecen ser la solución a la que está apostando la industria. En mayo, WaveOptics fue adquirida por Snap (otro gigante de las redes sociales que mira hacia el metaverso) y en noviembre, la inversión de gigantes como Samsung Electronics en Digilens llevó a una valoración de 500 millones de dólares. Ambas son empresas de guías de ondas sin fábulas. Un desarrollo emocionante de Digilens es su guía de ondas TREX, que puede duplicar la resolución de pantalla efectiva, proporcionando un arma en el arsenal para alcanzar los 60ppd. Otro informe sobre óptica y pantallas en AR, VR y MR cubre las tecnologías, los jugadores y los mercados, y profundiza en el combinador óptico y la tecnología de pantalla en estas aplicaciones en detalle.

Tecnología de seguimiento ocular

Si intentara construir un auricular que cubriera los 135 ° del campo de visión horizontal de cada ojo con una resolución de 60ppd, las cosas se volverían inmanejables rápidamente; afortunadamente, solo el centro de nuestra visión es de esta alta calidad, y los bordes exteriores no lo son exigente. Al seguir nuestros ojos, la resolución se puede maximizar en el centro de donde mira el usuario mientras se reducen las demandas en otros lugares.

En el futuro, esta tecnología de seguimiento ocular puede incluso usarse para proyectar imágenes AR / VR directamente en la retina mediante un escaneo de rayo láser, evitando la necesidad de una óptica combinada y corrección para los usuarios de anteojos:es decir, si los consumidores pueden sentirse cómodos con la idea.

Las empresas en este espacio están utilizando tecnologías emergentes de sensores de imagen para rastrear el ojo de manera más eficiente. La visión basada en eventos puede ayudar a mantener bajas las demandas de procesamiento al grabar de forma nativa el movimiento en lugar de una secuencia de cuadros de imagen convencionales. Mediante el uso de sensores de imagen impresos, la tecnología de seguimiento ocular puede integrarse en un paquete más esbelto. Meta Materials Inc. (sin relación con Meta) ya está incorporando microcámaras directamente en lentes de gafas y este enfoque se integrará en la óptica combinada o de aumento para AR y VR respectivamente a medida que la tecnología madure.

Haptics y experiencias sensoriales

Todo lo que se ha discutido hasta ahora equivale a poco más que un televisor de alta gama atado a su cara si no puede interactuar con él de una manera que se parezca al mundo real. Los dispositivos AR y VR no solo necesitan detectar nuestros movimientos, sino que, para una inmersión total, también se requieren dispositivos hápticos (retroalimentación táctil). En noviembre de 2021, la división Reality Labs (RL) de Meta mostró un prototipo de producto de guantes hápticos, que incluía videos de Mark Zuckerberg probando varias demostraciones. Este guante utiliza sistemas de microfluidos para proporcionar retroalimentación háptica local a diferentes áreas de la mano, lo que parece brindar más retroalimentación táctil a cada dedo. Aunque hubo cierta controversia sobre el parecido de este prototipo con un producto de HaptX, la posición de IP de Meta es fuerte aquí y representa los esfuerzos que están realizando las empresas centradas en el metaverso para garantizar que se entreguen experiencias sensoriales más allá del audiovisual, según IDTechEx.

El analista dijo que un ganador clave en el lado de los sensores en los auriculares recientes ha sido el tiempo de las cámaras de vuelo para el seguimiento manual, eliminando la necesidad de interacciones de estilo de controlador de juego con dispositivos de realidad virtual y realidad aumentada. Se sabe que Apple ha invertido en el espacio VR / AR durante años y, en octubre de 2021, fuentes de la industria informaron que LG Innotek había comenzado a suministrar cámaras de tiempo de vuelo a la empresa para un auricular VR programado para su lanzamiento en 2022. Cuando Apple adopta una tecnología, por lo general es una afirmación contundente de que está a punto de volverse omnipresente, lo que representa otro punto de datos en el futuro sólido para AR y VR.

IDTechEx concluye diciendo que, de forma limitada, el metaverso ya está aquí. La montaña del desarrollo de hardware que impide su realización completa se está escalando lentamente y las gafas AR livianas y atractivas que reemplacen nuestros teléfonos y computadoras portátiles en el futuro parece una certeza cercana.

Sensor

- Los mejores accesorios para tu Raspberry Pi

- VISTA:Para ciegos

- El futuro de la entrega sin contacto

- El IoT cambia las reglas del juego para el mantenimiento de flotas

- Los siete requisitos para el mecanizado optimizado

- El caso de la impresión 3D en la fabricación

- Linterna lunar para buscar agua en la Luna

- ¿Qué hará la 5G por el IoT/IIoT?

- Un método escalable para la integración de áreas grandes de materiales 2D

- El reto del método 5S para la industria 4.0

- ¡Gracias por los recuerdos!