Debut de los kits de desarrollo de computación neuromórfica

BrainChip, el proveedor de IP de computación neuromórfica, lanzó dos kits de desarrollo para su procesador neuromórfico Akida durante la reciente Conferencia Linley Fall Processor. Ambos kits cuentan con el SoC neuromórfico Akida de la empresa:un kit de desarrollo de PC Shuttle x86 y un kit Raspberry Pi basado en Arm. BrainChip ofrece las herramientas a los desarrolladores que trabajan con su procesador de red neuronal de picos con la esperanza de obtener una licencia para su IP. El silicio Akida también está disponible.

Las tecnologías neuromórficas de BrainChip permiten una IA de potencia ultrabaja para analizar datos en sistemas de borde donde se busca el procesamiento de datos de sensores en tiempo real y de potencia extremadamente baja. La compañía ha desarrollado una unidad de procesamiento neuronal (NPU) diseñada para procesar redes neuronales de picos (SNN), una red neuronal inspirada en el cerebro que difiere de los enfoques convencionales de aprendizaje profundo. Al igual que el cerebro, un SNN se basa en "picos" que transmiten información espacial y temporalmente. Es decir, el cerebro reconoce ambas secuencias y el momento de los picos. Conocidos como el "dominio de eventos", los picos generalmente son el resultado de cambios en los datos del sensor (por ejemplo, cambios en los colores de los píxeles en una cámara basada en eventos).

Junto con las SNN, las NPU de BrainChip también pueden procesar redes neuronales convolucionales (CNN) como las que se usan normalmente en la visión por computadora y los algoritmos de detección de palabras clave con menor potencia que otras implementaciones de borde. Esto se hace convirtiendo CNN en SNN y ejecutando inferencias en el dominio de eventos. El enfoque también permite el aprendizaje en chip en el borde, una calidad de SNN que se extenderá a CNN convertidas.

Las placas de desarrollo de BrainChip están disponibles para x86 shuttle PC o Raspberry Pi. (Fuente:BrainChip)

Akida "está lista para la tecnología neuromórfica del mañana, pero resuelve el problema actual de hacer posible la inferencia de redes neuronales en dispositivos periféricos e IoT", dijo Anil Mankar, cofundador y director de desarrollo de BrainChip, a EE Times .

La conversión de CNN al dominio de eventos se realiza mediante el flujo de herramientas de software de BrainChip, MetaTF. Los datos se pueden convertir en picos y los modelos entrenados se pueden convertir para ejecutarse en la NPU de BrainChip.

“Nuestro software de tiempo de ejecución está quitando el miedo de '¿Qué es un SNN?' Y '¿Qué es el dominio de eventos?'”, Dijo Mankar. “Hacemos todo lo posible para ocultar eso.

"Las personas que están familiarizadas con la API de TensorFlow o Keras ... pueden tomar la aplicación que están ejecutando en [otro hardware], la misma red, el mismo conjunto de datos, con nuestra capacitación consciente de cuantificación, y ejecutarla en nuestro hardware y medir la potencia ellos mismos y ver cuál será la precisión ".

Las CNN son particularmente buenas para extraer características de grandes conjuntos de datos, explicó Mankar, y la conversión al dominio de eventos conserva ese beneficio. La operación de convolución se logra en el dominio de eventos para la mayoría de las capas, pero se reemplaza la capa final. Reemplazarlo con una capa que reconoce los picos entrantes le da a la CNN ordinaria la capacidad de aprender a través de la plasticidad dependiente del tiempo de los picos en el borde, eliminando el reentrenamiento en la nube.

Mientras que los SNN nativos (aquellos escritos desde cero para el dominio de eventos) pueden usar precisión de un bit, los CNN convertidos requieren picos de 1, 2 o 4 bits. La herramienta de cuantificación de BrainChip ayuda a los diseñadores a decidir cuán agresivamente cuantificar capa por capa. Brainchip ha cuantificado MobileNet V1 para la clasificación de 10 objetos con una precisión de predicción del 93,1 por ciento después de la cuantificación a 4 bits.

Un subproducto de la conversión al dominio de eventos es un importante ahorro de energía debido a la escasez. Los valores del mapa de activación distintos de cero se representan como eventos de 1 a 4 bits, y la NPU solo realiza el cálculo de los eventos en lugar de todo el mapa de activación.

Los desarrolladores "pueden mirar los pesos y ver pesos distintos de cero, y tratar de evitar multiplicar por pesos cero", dijo Mankar. "Pero eso significa que debe saber dónde están los ceros, y se requiere un cálculo" para esas operaciones.

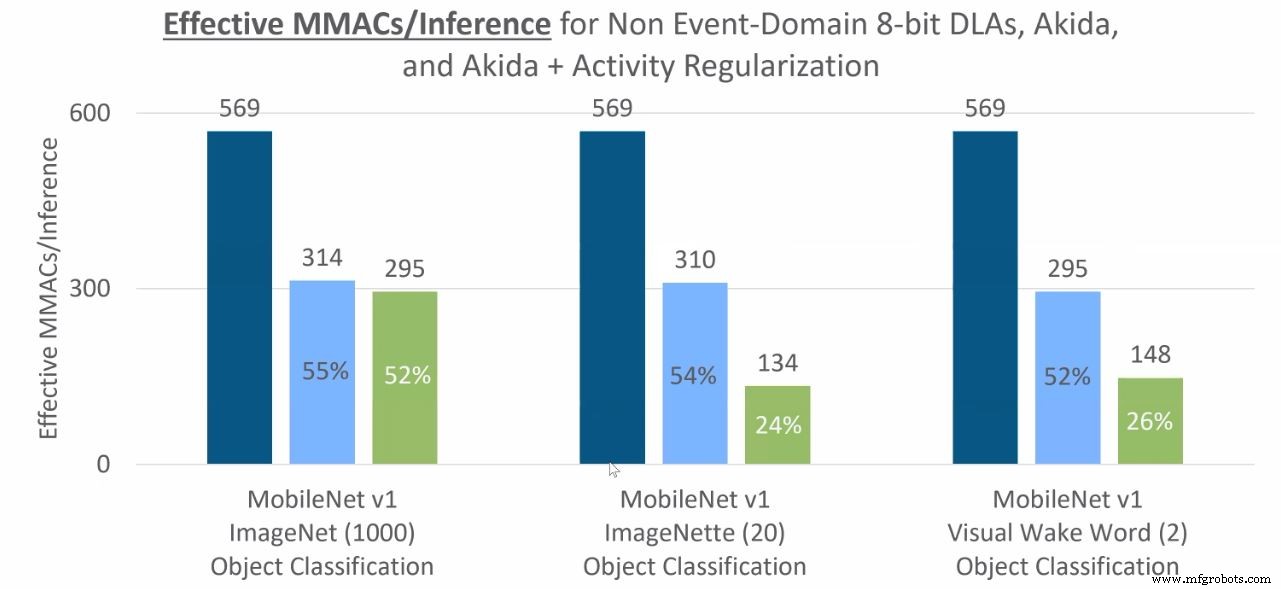

Para una CNN típica, el mapa de activación cambiaría con cada fotograma de video, ya que las funciones de ReLU se centran alrededor de cero; por lo general, la mitad de las activaciones será cero. Al no hacer picos a partir de estos ceros, el cálculo en el dominio de eventos se limita a activaciones distintas de cero. La conversión de CNN para que se ejecuten en el dominio de eventos puede aprovechar la escasez, lo que reduce rápidamente la cantidad de operaciones MAC necesarias para la inferencia y, por lo tanto, la energía consumida.

Entre las funciones que se pueden convertir al dominio de eventos se incluyen la convolución, la convolución puntual, la convolución en profundidad, la agrupación máxima y la agrupación promedio global.

Operaciones MAC requeridas para la inferencia de clasificación de objetos (azul oscuro es CNN en el dominio sin eventos, azul claro es dominio de eventos / Akida, verde es dominio de eventos con mayor regularización de actividad). (Fuente:BrainChip)

En un ejemplo, un modelo de detección de palabras clave que se ejecuta en la placa de desarrollo Akida después de la cuantificación de 4 bits consumió tan solo 37 µJ por inferencia (o 27,336 inferencias por segundo por vatio). La precisión de la predicción fue del 91,3 por ciento y el chip se redujo a 5 MHz para lograr el rendimiento observado. (vea el gráfico a continuación).

Independiente del sensor

La NPU IP de BrainChip y el chip Akida son independientes del tipo de red y se pueden utilizar junto con la mayoría de los sensores. El mismo hardware puede procesar datos de imagen y audio mediante la conversión de CNN o los SNN de BrainChip para detección olfativa, gustativa y de vibración / táctil.

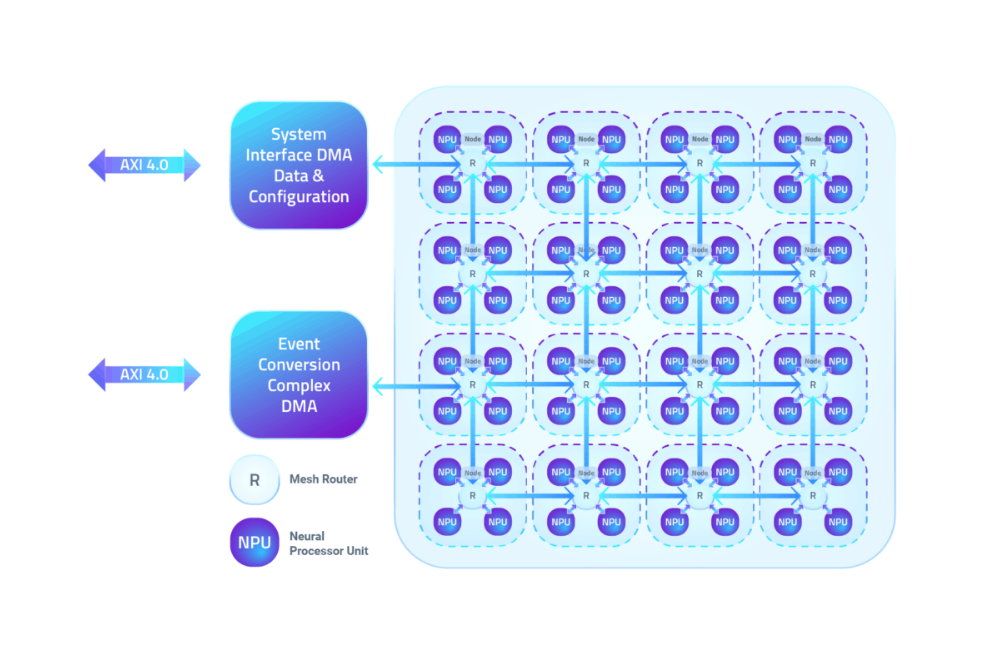

Las NPU se agrupan en nodos de cuatro, que se comunican a través de una red de malla. Cada NPU incluye procesamiento y 100 kB de SRAM local para parámetros, activaciones y búfer de eventos internos. Las capas de red CNN o SNN se asignan a una combinación de múltiples NPU, pasando eventos entre capas sin soporte de CPU. (Si bien las redes que no sean CNN se pueden convertir al dominio de eventos, Mankar dijo que requieren una CPU para ejecutarse en Akida).

La NPU IP de BrainChip se puede configurar para hasta 20 nodos, y se pueden ejecutar redes más grandes en múltiples pasadas en diseños con menos nodos.

Los nodos de cuatro NPU BrainChip están conectados por una red en malla. (Fuente:BrainChip)

Un video de BrainChip mostró un chip Akida desplegado en el sistema de cabina de un vehículo, con un chip utilizado para detectar un conductor, reconocer la cara del conductor e identificar su voz simultáneamente. La detección de palabras clave requirió 600 µW, el reconocimiento facial requirió 22 mW y la inferencia visual de la palabra de activación utilizada para detectar el controlador fue de 6-8 mW.

El bajo consumo de energía para tales plataformas automotrices ofrece flexibilidad a los fabricantes de automóviles en otras áreas, dijo Rob Telson, vicepresidente de ventas mundiales de BrainChips, y agregó que el chip Akida se basa en la tecnología de proceso de 28 nm de Taiwan Semiconductor Manufacturing Co. Los clientes de IP pueden ir a nodos de proceso más finos para ahorrar más energía, agregó Telson.

Mientras tanto, los sistemas de reconocimiento facial pueden aprender nuevas caras en el chip, sin cambiar a la nube. Un timbre inteligente podría, por ejemplo, identificar el rostro de una persona localmente a partir del aprendizaje de una sola vez. Siempre que a la última capa de las redes se le asigne un número suficiente de neuronas, el número total de caras reconocidas podría incrementarse de 10 a más de 50, señaló Mankar.

Clientes de acceso anticipado

BrainChip tiene 55 empleados repartidos en su sede y oficinas de diseño de Aliso Viejo, California, en Toulouse, Francia, Hyderabad, India y Perth, Australia. La empresa tiene 14 patentes y cotiza en la bolsa de valores australiana y en la bolsa de valores de EE. UU.

Aproximadamente 15 clientes de acceso temprano, incluida la NASA, dijo Telson. Otros incluyen compañías automotrices, militares, aeroespaciales, médicas (detección olfativa de Covid-19) y de electrónica de consumo. BrainChip tiene como objetivo aplicaciones de consumo como salud inteligente, ciudad inteligente, hogar inteligente y transporte inteligente.

Otro cliente temprano es el especialista en microcontroladores Renesas, que ha licenciado la IP de NPU Akida de 2 nodos para integrarse con una futura MCU destinada al análisis de datos de sensores en implementaciones de IoT, según Telson.

Akida IP y silicio ya están disponibles.

>> Este artículo se publicó originalmente en nuestro sitio hermano, EE Times.

Contenidos relacionados:

- Startup empaqueta 1000 núcleos RISC-V en un chip acelerador de IA

- El chip AI apunta a dispositivos periféricos de bajo consumo

- Los SoC habilitados para IA manejan múltiples transmisiones de video

- Integrar la seguridad en un SoC de IA mediante funciones de CPU con extensiones

- Las arquitecturas de microcontroladores evolucionan para la IA

Para obtener más información sobre Embedded, suscríbase al boletín informativo semanal por correo electrónico de Embedded.

Incrustado

- Una guía para la computación en la nube en Linux

- 10 ventajas de la computación en la nube en 2020

- Computación en la nube frente a las instalaciones

- Grupos de indicadores de eventos:introducción y servicios básicos

- Defensa de los chips neuromórficos para la informática de IA

- Kontron:nuevo estándar informático integrado COM HPC

- Los kits de desarrollo de bajo costo aceleran el desarrollo de LoRaWAN

- El kit de desarrollo ayuda a acelerar el diseño de ECU automotrices

- El kit de desarrollo simplifica la red de malla BLE

- Los kits de desarrollo utilizan un sensor de imagen de 1 x 1 mm

- C# - Eventos