¿Qué hay detrás del cambio a los agentes de voz personalizados?

La automatización es el camino del futuro. Vivimos en la era del ahora, deseando que todo sea respondido, logrado y recibido a gran velocidad. A pesar de este cambio fundamental, muchas personas no adoptan la tecnología. Para algunos, está relacionado con el estilo de vida:las grandes empresas pueden ser demasiado torpes para transformar su sistema, y las personas pueden quedarse estancadas en sus caminos y no querer aprender a navegar por una pantalla táctil. Para la mayoría, sin embargo, todo se reduce a los datos:a quién pertenecen y cómo mantenerlos seguros.

¿La solución? Es tan simple como la voz. La tecnología de habilitación de voz puede desbloquear la necesidad de automatización mientras mantiene los datos cerca, y es algo que usamos todos los días sin importar el lugar o la plataforma. A medida que la transformación digital continúa impactando cada vez más aplicaciones, los agentes de voz son la respuesta. Más empresas están explorando la creación de plataformas de voz personalizadas, integradas en la tecnología, además de nombres conocidos de agentes de voz como Alexa y Google Voice. Las plataformas de voz únicas serán el camino a seguir para las empresas que buscan mantener y controlar sus propios datos.

Detrás de la disrupción está la automatización

A medida que Internet de las cosas (IoT) se basa en la inteligencia artificial (IA), comenzamos a ver la necesidad de que la automatización crezca. Cuando IoT colabora con AI, mejora el control que los usuarios tienen sobre las vastas y amplias colecciones de dispositivos de Internet. Estamos comenzando a ver que la habilitación de voz se expande en el hogar y más allá, interactuando a través de plataformas como Google Voice, Amazon Alexa, Microsoft Cortana o plataformas creadas de forma única. En Harman Embedded Audio, hemos trabajado con todos los motores de voz del planeta y comprendemos de primera mano la amplitud del mercado. Vemos más empresas que buscan construir sus productos habilitados para voz en sus propias plataformas de asistentes de voz personalizadas, para que tengan el control de los datos.

La demanda de control por voz está creciendo

Es una de las últimas tendencias en audio. La próxima gran novedad en la interfaz de usuario, ahora que funciones como las pantallas táctiles son casi omnipresentes, es poder hablar con un dispositivo. Voice lidera la próxima generación de colaboración humana. Piense en el procesamiento del lenguaje natural en una computadora:la voz se procesa de una manera que se ajusta a lo que la máquina preferiría escuchar, pero si reprodujera el mismo archivo procesado, sería mecánico y antinatural. Lo mismo ocurre con hablar por teléfono:no da la misma impresión de estar en una habitación con alguien. Aquí es donde debe ir la voz y donde seguirán las plataformas de voz únicas mencionadas anteriormente.

Cómo se ven los agentes de voz personalizados y qué implica la compilación

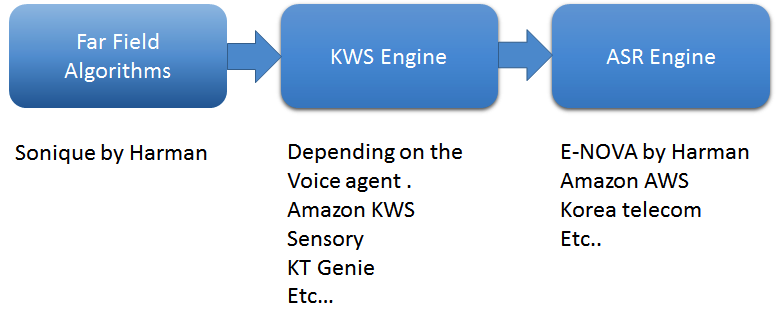

Si bien cada solución de voz es diferente, es importante que todas las soluciones sean lo suficientemente flexibles para adaptarse a los requisitos necesarios de su caso de uso y, al mismo tiempo, recopilar y proteger los datos del usuario. Para lograr esto, hay tres elementos principales involucrados en la construcción e integración de cualquier agente de voz.

El primero son los algoritmos de campo lejano. Utilice un algoritmo de primer nivel que capture la voz de campo lejano. En mi empresa, utilizamos cuatro algoritmos de software clave de Sonique:supresión de ruido, cancelación de ruido acústico, separación de sonido y formación de haz, así como detección de actividad de voz. Estos algoritmos están desarrollados específicamente para usarse en combinación entre sí para admitir aplicaciones habilitadas por voz.

¿Cómo trabajan? Piense en comparar un altavoz inteligente con un humano. El DSP / SOC actúa como el "cerebro" del hablante, los micrófonos son los oídos y los altavoces son la boca. Para nosotros, cuando alguien dice nuestro nombre, nuestro cerebro cancela todos los ruidos que nos rodean y pone toda su energía en esa palabra clave. Esto es lo que hemos logrado con un altavoz inteligente:cuando se detecta la palabra clave, el micrófono utiliza diferentes técnicas de supresión de ruido y pone todo su poder en la fuente. En el proceso, cancela la mayor parte del ruido a su alrededor. En entornos acústicos, hay muchas fuentes de ruido, como ruido ambiental, altavoces locales, HVAC y más, que hacen eco de la retroalimentación del altavoz al micrófono. Cada una de estas fuentes de ruido necesita su propia solución individual. Los algoritmos de Sonique suprimen los ruidos y capturan el mejor comando de voz claro posible.

Además, la creación de un motor de detección de palabras clave (KWS) es crucial. KWS detecta palabras clave como "Alexa" o "OK Google" para iniciar una conversación. He trabajado con casi todos los proveedores de motores de KWS, y cada uno de ellos funciona con redes neuronales profundas:altamente personalizables, siempre escuchando, livianas e integradas. Para una excelente experiencia del cliente en una aplicación de voz de campo lejano, el componente crucial es una tasa de aceptación falsa y rechazo falso. En una condición del mundo real, es realmente difícil mantener una tasa baja de falsos rechazos, ya que hay muchos ruidos externos, como televisores, electrodomésticos, duchas, etc., que provocan una cancelación imperfecta de la reproducción de audio. Los desarrolladores experimentados ajustan el motor KWS para mantener baja la tasa de aceptación falsa.

Por último, el motor de reconocimiento automático de voz (ASR) convierte la voz en texto. ASR consta de la herramienta principal de voz a texto (STT) y comprensión del lenguaje natural (NLU), que convierte el texto sin procesar en datos. El motor también requiere habilidad, o, en otras palabras, una base de conocimientos a partir de la cual se puedan proporcionar respuestas, así como la herramienta inversa de texto a voz. Hemos desarrollado un motor ASR llamado E-NOVA, por ejemplo, que ofrece integraciones multiplataforma, en las instalaciones, admite varios idiomas (actualmente siete idiomas y sigue creciendo) e incluye modelos entrenables, soporte de integración de terceros e identificación del hablante.

ASR es el primer paso que permite que las tecnologías de voz como Amazon Alexa, OK Google, Cortana o el cliente respondan cuando se les solicite, "¿qué tiempo hace en Los Ángeles?" Es la parte clave que detecta el sonido hablado, las reconoce como palabras, las empareja con el sonido en un idioma determinado y, en última instancia, identifica las palabras que decimos. Gracias al motor ASR, la conversación se siente natural. Y, con las tecnologías modernas, la mayoría de los motores ASR aprovechan la computación en la nube. Con tecnologías adicionales como NLU, las conversaciones entre humanos y computadoras se están volviendo más inteligentes y complejas.

Figura 1:Canalización de procesamiento básico en agentes de voz. (Fuente:Harman Embedded Audio)

Sin embargo, la creación de agentes de voz personalizados presenta una serie de desafíos únicos. Comprender el entorno del producto es uno de los desafíos clave del proceso, y cada aplicación variará según el caso de uso específico. Por ejemplo, imagine cocinar en su casa, sus manos están ocupadas y ocupadas, cuando es el momento de hervir un poco de agua, todo lo que se necesita es una solicitud rápida al agente de voz conectado a su espacio de plomería:"Hierva el agua a x grados". El desafío aquí es si el dispositivo puede escuchar lo que dijo y cuánto ruido cancelará el dispositivo para obtener una señal limpia y escucharlo correctamente. Para garantizar esto, los algoritmos de voz deben ajustarse a entornos hostiles, las ubicaciones de los micrófonos deben ajustarse para que puedan captar el sonido y deben usarse altavoces de baja THD para ayudar a una alta SNR para los micrófonos. A través de esto, obtendrá el audio más claro posible para el motor ASR, lo que dará como resultado la respuesta correcta a sus preguntas.

Además, imagina estar en un crucero:los ruidos a tu alrededor son completamente diferentes a los que escuchas en una sala de estar o en la cocina. El mayor desafío es entrenar algoritmos para suprimir esos ruidos y obtener una señal de audio limpia en el sistema para una respuesta precisa. Si se implementa correctamente, un sistema de asistente de crucero personal virtual como el que desarrollamos para MSC Cruceros puede completar de manera confiable los pasos que se muestran en la Figura 2.

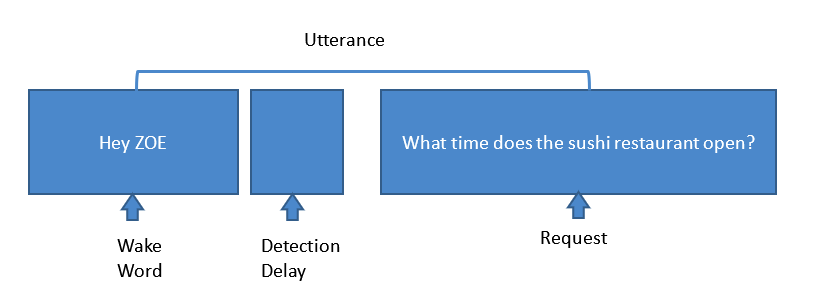

Figura 2:Pasos involucrados en una solicitud típica de asistente de voz. (Fuente:Harman Embedded Audio)

Aquí, una unidad de asistente de voz en la habitación del pasajero detecta la palabra de activación "Hey Zoe". Luego, cuando KWS detecta la palabra clave, todo el micrófono, basado en algoritmos de supresión de ruido, desvía su energía hacia la fuente y cancela el ruido circundante, como el ruido de CA, la televisión, los ruidos no correlacionados, los ruidos de la hélice y del motor, los ruidos del viento, AEC. , etc. Los algoritmos de Sonique están ajustados para cancelar todos estos ruidos y obtener la señal más limpia posible para el sistema. Luego, cuando los sistemas reciben la solicitud, el motor ASR convierte esta voz en texto. Los motores de NLU luego convierten este texto en datos sin procesar para obtener la respuesta. Pero aún no hemos terminado. Para obtener la respuesta que está buscando, la habilidad de conocimiento proporciona la respuesta a la solicitud y el motor ASR convierte ese texto de datos en voz y lo emite a través del altavoz.

Otro desafío está en torno al rechazo de tasa falsa (FRR). El proceso para lograr Wake Word FRR, que es uno de los puntos de control utilizados para medir el rendimiento de los altavoces inteligentes, requiere mucho tiempo y es costoso. El sistema se utiliza para verificar si el producto puede activarse correctamente cada vez que se detecta una palabra de activación. Para lograr FRR, las palabras clave capacitadas son esenciales. En nuestra experiencia, la combinación del modelo entrenado con un algoritmo de primer nivel permite a los equipos de desarrollo superar el desafío y lograr el mejor FRR posible. La respuesta de la palabra de activación se prueba aún más en varias condiciones en un laboratorio para garantizar que el sistema cumpla con los estándares de la industria.

Las ventajas de emplear agentes de voz únicos

Los agentes de voz ofrecen un gran valor a la experiencia del usuario. La música es el caso de uso más grande y simple, pero el valor de los agentes de voz se extiende mucho más allá de abrir su cuenta de Spotify de forma remota. La voz puede encender cosas, interactuar con electrodomésticos, hervir agua, abrir un grifo, ¡y más! La voz es poderosa y los agentes saben mucho sobre sus usuarios, razón por la cual las empresas buscan hacerse con sus propios datos:poseerlos, almacenarlos y protegerlos.

Las soluciones de voz tienen amplias aplicaciones, pero la clave es aprovechar una tecnología que funcione en todas las plataformas, una que sea relevante para altavoces inteligentes, computadoras portátiles y teléfonos inteligentes, en Apple, Windows o Android, y aprovechar los datos recopilados para crear un agente que comprenda, aprende y recuerda constantemente las necesidades del usuario. La creación de un agente de voz único permite esta flexibilidad de uso y, al mismo tiempo, mantiene los datos internos.

Incrustado

- ¿Qué es el vidrio metálico?

- Ruedas vs ruedas:¿Cuál es la diferencia?

- ¿Cuál es la diferencia entre la producción en masa y la producción personalizada?

- ¿Qué es el cambio de plataforma en la nube?

- ¡¿Qué hago con los datos ?!

- ¿Qué es la economía circular?

- Motor de CC frente a motor de CA:¿cuál es la diferencia?

- ¿Qué hay en el proceso de fabricación?

- ¿Qué es la industria gráfica?

- ¿Qué es la industria de la pintura?

- ¿Qué es la industria del embalaje?