Robótica guiada por visión

Parte I

El impulsor detrás de la digitalización es la creciente demanda de precisión, calidad mejorada y confiabilidad. La dinámica del mercado ha obligado a la industria manufacturera a incorporar nuevos productos, diseños modificados para adaptarse a los sentimientos cambiantes de los consumidores, personalizaciones y entregas más rápidas. Los robots han sido los amigos de la industria manufacturera durante décadas, al igual que la "visión artificial" per se.

La robótica y la visión artificial han alcanzado de forma independiente estabilidad y madurez tecnológica. Los desarrollos recientes han sido bastante complementarios entre sí para hacer que los procesos sean más eficientes. Este artículo aclarará algunas ideas sobre robótica guiada por visión (VGR) en el segmento de manufactura. Aunque VGR es igualmente relevante para otros tipos de robots, como robots móviles, humanoides, cartesianos y SCARA, nos centraremos en las aplicaciones y desafíos de los robots articulados. .

Antes de profundizar en nuestro tema central, es importante comprender algunos conceptos importantes de la visión artificial y los robots industriales.

Visión artificial puede definirse como la atomización del ver humano. No solo necesita capturar una imagen (la función de nuestros ojos), sino también procesar estas imágenes y generar resultados (la función del cerebro). Los sistemas de visión artificial se basan en sensores digitales protegidos dentro de cámaras industriales con óptica especializada para adquirir imágenes, de modo que el hardware y el software de la computadora puedan procesar, analizar y medir diversas características para la toma de decisiones.

Las aplicaciones típicas de visión artificial se pueden clasificar en términos generales en cuatro tipos, a saber:

- Orientación

- Identificación

- Medición

- Inspección

Si bien las tareas como los sistemas de identificación, medición e inspección tienen sus propios propósitos en los que los robots agregan valor a la aplicación, nuestro enfoque en este artículo es la guía del robot. . Los sistemas de visión artificial (MV) pueden ubicar una pieza y asegurarse de que se coloque correctamente en un ensamblaje en particular. Los sistemas MV también pueden ayudar a identificar la ubicación de un componente en el espacio 2D o 3D y ayudar a los robots a rastrear con precisión las coordenadas de este componente. Los sistemas de media tensión reducen la complejidad de disponer de las luminarias necesarias para este fin. Para comprender esto, primero debemos observar cómo se posiciona un robot para ubicar el componente.

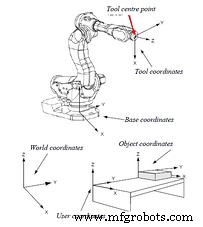

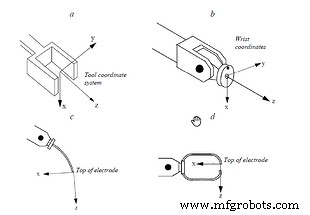

Un sistema de coordenadas de robot se compone de diferentes marcos de referencia. Los principales sistemas de coordenadas utilizados para describir el movimiento de un robot se muestran a continuación en la Figura 1.1 . El control de la pinza o la herramienta es lo más importante y su posición se logra a través de movimientos coordinados de uno o todos los ejes del robot. Debido a que los diferentes tipos de pinzas y herramientas tienen diferentes dimensiones, se selecciona un punto especial llamado punto central de la herramienta (TCP), independientemente del tipo de herramienta. Este punto es el punto de origen del sistema de coordenadas de la herramienta. Se puede usar un punto similar para describir la pinza o el sistema de coordenadas de la muñeca. Las conexiones mutuas de una herramienta, una muñeca y otros sistemas de coordenadas se muestran en la Figura 1.2 .

Figura 1.1

Figura 1.2

Imágenes:Robótica ABB

El TCP guarda relación con los sistemas de coordenadas de la muñeca, las coordenadas de la base, las coordenadas del mundo y los sistemas de coordenadas del objeto. Idealmente, se espera que las coordenadas del objeto coincidan con precisión con las coordenadas establecidas del TCP, lo que significa que el punto de origen del objeto se enseña al robot a través de la programación y se registran las coordenadas TCP. Por lo tanto, para lograr una precisión repetida, el robot y el objeto deben llegar siempre al mismo punto.

El posicionamiento del robot se rige por servomecanismos y, por lo tanto, es bastante preciso. En el caso de componentes ubicados fijos, su precisión de posicionamiento depende de una serie de factores, como las tolerancias de mecanizado, las tolerancias de los accesorios de ubicación y la precisión y repetibilidad del posicionamiento de la mesa indexadora. Por lo tanto, es posible que el TCP del robot no coincida con las coordenadas reales del objeto debido al desplazamiento entre sus coordenadas deseadas y reales, y habrá un error de posicionamiento. Si se espera que el robot recoja el objeto o realice alguna operación en él mientras el objeto se coloca aleatoriamente sobre un transportador, entonces determinar su origen se vuelve casi imposible si no hay un sistema como la visión artificial para guiarlo.

Si se implementan, los sistemas de visión artificial pueden identificar las coordenadas en tiempo real del objeto y enviarlas al robot, que luego compensa el desplazamiento en el TCP. De este modo se garantiza la precisión de posicionamiento de la herramienta. Este método se usa principalmente para aplicaciones tales como soldadura y dispensación de pegamento, para componentes de accesorios y para la "selección y colocación" robótica de objetos distribuidos al azar en un transportador en movimiento. Los ejemplos anteriores son válidos para objetos que tienen imprecisiones de posicionamiento a lo largo del plano 2D, por lo que un sistema de visión artificial 2D se usaría.

"Recogida y colocación" robótica de alta velocidad de objetos utilizando guía de visión 2D. Imagen:Corporación Cognex

Para aplicaciones como la recolección robótica de contenedores, donde se espera que el robot recoja objetos guardados aleatoriamente en un contenedor, se hace necesario el análisis espacial 3D. Aquí, no solo son importantes las coordenadas X, Y y Z, sino que los ángulos de orientación a lo largo de los tres ejes son cruciales para que el robot identifique el objeto más fácil de recoger sin colisiones. Es obvio que los sistemas de visión artificial 3D se implementan en esta configuración.

El sistema de visión artificial 3D más popular es una configuración que utiliza visión estéreo con dos cámaras que proporcionan coordenadas y el mapa de altura. La tarea crucial aquí es la calibración de la cámara y el algoritmo de visión artificial que combinará las imágenes de ambas cámaras y creará una imagen 3D. Se analiza una imagen del contenedor para derivar las coordenadas TCP del componente más fácil de seleccionar. Algunas otras técnicas 3D son la triangulación láser y el tiempo de vuelo.

Recolección robótica de contenedores con guía de visión 3D. Imagen:Robótica Yaskawa

Recolección robótica de contenedores con guía de visión 3D. Imagen:Robótica Yaskawa

Parte II

Adquisición de imágenes

Una imagen de buena calidad es la clave para un VGR exitoso. Los tres componentes principales aquí son la cámara, la óptica y la iluminación.

Cámara: Hay algunas cosas importantes a tener en cuenta durante la selección de cámaras para aplicaciones robóticas. Aunque las cámaras comerciales en el mercado adquieren imágenes, los entornos industriales donde se implementan estos sistemas pueden ser realmente desafiantes. Aquí, las cámaras están expuestas a entornos hostiles y se espera que brinden imágenes consistentes de buena calidad cada vez durante cientos de miles de ciclos. Agregue a eso los impactos y las vibraciones ocasionados por los movimientos del robot y las vibraciones generales del equipo.

Las interfaces de comunicación deben ser sólidas y mantenerse en estas condiciones difíciles para que no haya interrupciones en las comunicaciones durante la operación. Los protocolos basados en Ethernet ofrecen una buena confiabilidad y las longitudes de cable más largas necesarias para esta aplicación El cumplimiento de la protección de entrada se vuelve crucial, especialmente si el sistema se implementa en un entorno polvoriento. PoE es una fuente de alimentación preferible para evitar múltiples cables. Los cables de la cámara están sujetos a una gran cantidad de flexión cíclica a través de bandejas de cables y arneses en el brazo del robot, por lo que se deben utilizar cables compatibles con cadenas de arrastre.

Imagen:Baumer

Imagen:Baumer

Imagen:Pickit 3D

Imagen:Pickit 3D

La resolución de la cámara debe calcularse teniendo en cuenta el campo de visión general (FOV) y la precisión de posicionamiento deseada.

Óptica: Se debe seleccionar la óptica adecuada según el FOV, la distancia de trabajo (WD) y el tamaño del sensor de la cámara. Los dos factores más importantes a considerar son:

- La distorsión de barril debe mantenerse al mínimo posible, y

- La robustez de la lente, ya que está sujeta a la misma cantidad de golpes y vibraciones que la cámara; las configuraciones cruciales de la lente, como el iris y el enfoque, pueden verse afectadas si no se abordan

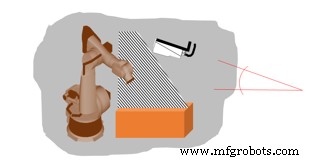

Iluminación: La iluminación del objeto juega un papel crucial en VGR. La iluminación debe ser tal que resalte la característica a inspeccionar en el componente. El componente o el contorno que se programa debe identificarse con precisión dentro de la precisión deseada del sistema. Por lo tanto, según el objeto y el contorno, se debe seleccionar la iluminación adecuada. Mientras que el tipo de aplicaciones de selección de componentes o soldadura/dispensación de pegamento en su mayoría requieren luces de barra difusas simples, las aplicaciones de recolección de contenedores robóticos que utilizan cámaras estéreo a menudo utilizan luces de patrones estructurados proyectados en el componente para recopilar contornos y derivar perfiles.

Iluminación estructurada utilizada en la selección de contenedores en 3D. Imagen:Solomon 3D

Desafíos de la robótica con visión artificial

En una aplicación de visión artificial robótica 2D estándar, existen varios desafíos que deben abordarse:

- Distorsiones

- Calibración de coordenadas

- Calibración Z

- Alineación de coordenadas

Distorsiones: Hay dos tipos principales de distorsiones que ocurren y deben corregirse antes de que el sistema de visión esté listo para el VGR.

- Distorsiones de lentes: Las lentes (especialmente las de gran angular) provocan distorsiones en la imagen adquirida. Esto se conoce como “distorsión de barril”.

Distorsión de barril. Imagen:Baumer

- Distorsiones causadas por el montaje inclinado de la cámara

Imagen:Baumer

Imagen:Baumer

Los robots requieren autorización para funcionar, por lo que las cámaras a menudo deben montarse en una posición inclinada. Esto provoca distorsión en la imagen adquirida.

Ambos tipos de distorsiones necesitan corrección y calibración para que las coordenadas adquiridas sean precisas.

Calibración de coordenadas: Los robots funcionan en sistemas de coordenadas definidos en unidades como milímetros o pulgadas, mientras que las cámaras funcionan con recuentos de píxeles. Por lo tanto, se requiere calibrar la cámara para que el sistema comprenda la correlación entre los píxeles y las unidades de los sistemas de coordenadas.

Imagen:Baumer

Imagen:Baumer

Es importante que la medición se realice siempre a la misma distancia de trabajo (distancia entre la cámara y el objeto). Dado que los robots funcionan en 3D, el "agarre" también requiere una especificación "Z". .

Calibración Z: La calibración Z se usa para calcular las coordenadas X e Y si el eje Z varía dentro de la profundidad de campo* de la lente. La cámara se calibra utilizando un procedimiento específico con la placa de calibración (que se analiza más adelante).

Alineación de coordenadas: El robot y el sistema de visión tienen sus propios sistemas de coordenadas. Sus desviaciones son:

Para superar este problema, se lleva a cabo la calibración. El robot conoce su propia posición y también la posición del TCP, mientras que el sistema de visión se calibra en una placa de calibración. El robot calcula las compensaciones y se lleva a cabo la alineación.

Este es un paso muy importante. El robot debe seguir la ruta que comienza desde el punto de origen definido por el sistema de visión. Si no se ejecuta correctamente, la calibración incorrecta puede causar serias desviaciones de ruta y puede resultar en colisiones.

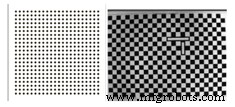

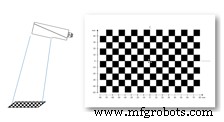

Placa de calibración: La calibración del sistema de visión se lleva a cabo utilizando una placa de calibración estándar que tiene marcas con dimensiones precisas. Figura 2.1 muestra algunos ejemplos de placas de calibración.

Figura 2.1

Corrección de la distorsión de la lente y el montaje usando la placa de calibración: La placa de calibración se coloca a cierta distancia debajo de la cámara y se adquiere la imagen, como se muestra en la Figura 2.2 .

Figura 2.2:Posicionamiento de la cámara

Imagen:Baumer

Una vez realizada la calibración de la distorsión, la imagen parece alineada. Esto se muestra a continuación en la Figura 2.3 .

Figura 2.3

Calibración de coordenadas usando placa de calibración: Las líneas de cuadrícula o marcas en la placa de calibración están relacionadas con la cantidad de píxeles cubiertos en la cámara. Es importante colocar el puntero de ubicación con precisión en la placa de calibración.

Los punteros se colocan en los puntos/esquinas de la placa. Las distancias entre estos puntos son conocidas y luego ingresadas en los campos de parametrización de calibración del software. Luego, el sistema de visión calcula la cantidad de píxeles consumidos para medir esa distancia. Esta configuración es válida siempre que se mantengan la distancia de trabajo, el FOV y los montajes de la cámara. El sistema debe volver a calibrarse si alguna de las tres cosas cambia.

Tendencias y Avances

VGR no es una tecnología nueva. Ya se ha desarrollado y se ha convertido en una aplicación bastante madura. Casi todos los fabricantes de robots ahora ofrecen soluciones integradas para VGR. Sin embargo, los últimos avances en tecnologías de cámaras (como cámaras de alta velocidad, cámaras de tiempo de vuelo en 3D y cámaras estéreo integradas) y en tecnologías de software (como inteligencia artificial y aprendizaje automático) han agregado esa pieza extra de confiabilidad y robustez a toda la aplicación.

Se implementan redes neuronales profundas para enseñar y volver a enseñar diferentes posibilidades de posicionamiento y orientación de los componentes a lo largo de todos los planos. Las muchas posibilidades que se pueden aprender pueden alargar el tiempo de entrenamiento de las redes, pero los últimos dispositivos informáticos (como la GPU) hacen que las tareas consuman menos tiempo. Actualmente también se están implementando plataformas basadas en la nube para el aprendizaje automático.

Conclusión

VGR está ganando rápida popularidad en todos los dominios de la industria. La aplicación, una vez impulsada en gran medida por el segmento automotriz, ahora encuentra otros interesados, como alimentos y productos farmacéuticos, para la recogida y colocación robótica de alta velocidad, paletización y despaletización, ingeniería pesada para el seguimiento de costuras de robots de soldadura, dispensación de pegamento, etc. Es necesario establecer estándares para garantizar la intercompatibilidad entre los fabricantes de sistemas de visión y los constructores de robots. A medida que el mundo mira hacia la "nueva normalidad" en la fabricación, VGR definitivamente tiene un papel importante que desempeñar.

Tecnología Industrial

- El futuro de la robótica

- Cuidado de máquinas robóticas:ventajas y desventajas

- El papel de la visión artificial en la robótica industrial

- Los mejores proveedores de máquinas de soldadura robotizadas en China

- Singularidad robótica:Qué hay en los brazos robóticos

- TM Robotics lanza un nuevo controlador de robot

- Cobot guiado por visión duplica la producción diaria

- Los robots obtienen coordinación ojo-mano

- La historia de la robótica en la fabricación

- Robótica industrial del siglo XXI

- ¿Qué es un Robot Café Barista?